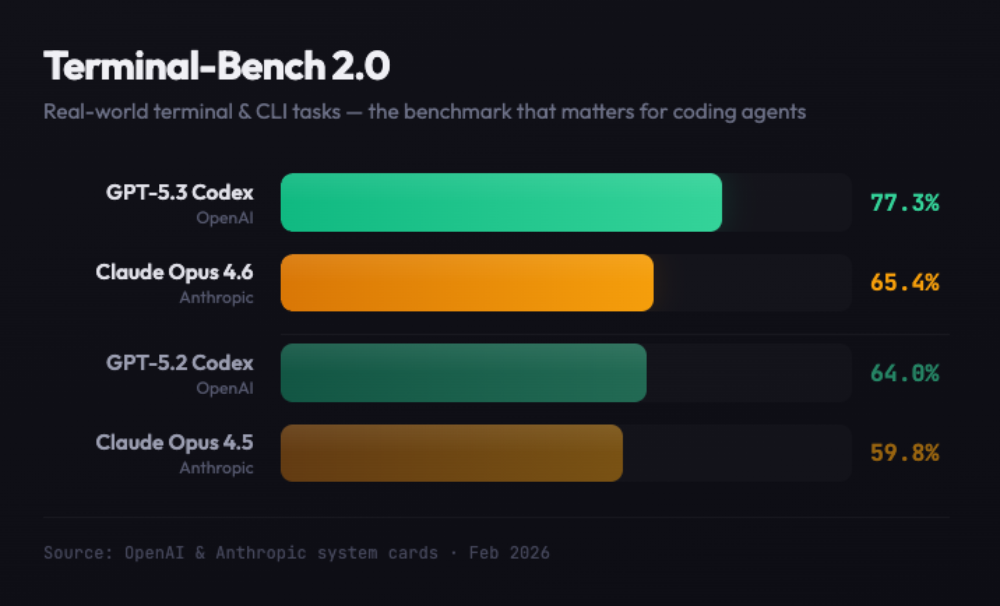

这篇对比不看宣传词,只看工程现场。GPT-5.3 Codex 和 Claude Opus 4.6 在同一类复杂重构任务里,呈现出了非常清晰的分工:5.3 Codex 更像高压救火型选手,追求一次跑通与交付速度;Opus 4.6 更像协作型架构师,强调解释充分、注释完整和后续可维护。你如果只拿单一基准测试做判断,结论很容易偏差。

如果你正在找可稳定体验 GPT-5.3 Codex 与多模型对照入口,可以用 AIMirror GPT 中文站 做主入口,再用 Write360 备用入口 做故障切换。

最后更新时间:2026-02-08

一、评测方法先讲清:为什么这轮对比值得看

这轮对比有价值的点,在于它不是“单文件 LeetCode”测试,而是多文件、跨模块、带历史包袱的业务重构。任务目标包含接口不破坏、回归测试通过、输出结构清晰、便于后续二次修改。这样的环境更接近企业研发,而不是演示场景。

GPT-5.3 Codex 在这类任务中的优势非常直接:执行果断、路径短、工具调用节奏稳定。你给出边界后,GPT-5.3 Codex 倾向于尽快交付一个可运行版本,再做局部修订。Opus 4.6 的路径相反,它会花更多时间做上下文整合和解释补全,交付速度慢一些,但产物文档化程度更高。

为了避免“谁快谁赢”的偏差,我把评估维度拆成四类:

- 交付效率:耗时、成功率、返工轮次。

- 工程质量:可读性、注释密度、结构一致性。

- 协作成本:新人接手难度、评审沟通时间。

- 长期成本:上线后修改代价与缺陷回流。

| 维度 | GPT-5.3 Codex 典型表现 | Opus 4.6 典型表现 | 业务影响 |

|---|---|---|---|

| 首次交付速度 | 快,常在单轮内给可运行方案 | 偏慢,前期解释和设计较多 | 紧急上线更偏向 5.3 Codex |

| 注释与文档 | 精简,默认写得少 | 详细,解释链完整 | 团队交接更偏向 Opus 4.6 |

| 代码风格 | 高压缩、高效率 | 可读性和教学友好 | 取决于团队经验结构 |

| 长会话稳定 | 依赖提示词约束 | 对复杂上下文更稳 | 重型项目更看 Opus 4.6 |

二、速度和成本:5.3 Codex 为什么会显得“无情高效”

5.3 Codex 的快,不只是响应快,而是决策路径短。你会看到它很少进行冗长解释,更多是直奔可运行目标。对救火场景,这几乎是完美风格:先恢复服务,再做整理。很多团队在事故窗口里就需要这种行为模式。

但这里有一个常见误判。很多人以为 GPT-5.3 Codex 速度快就一定更省钱。实际还要看返工。如果你的需求定义本身模糊,GPT-5.3 Codex 会把含糊要求也“快速实现”,随后你可能在第二轮、第三轮补约束,这些回合会吞掉原本节省的时间。

实践上更稳妥的方式是:让 GPT-5.3 Codex 负责“第一可运行版”,然后引入审校模型做结构与注释补全。这样你既拿到速度,也不会把维护债务全部留给后续同事。

三、代码可读性:GPT-5.3 Codex 的强项与短板同样明显

GPT-5.3 Codex 在逻辑压缩和路径选择上很强,经常能给出很“工程师友好”的高性能写法。问题在于,它对“给人看懂”这件事默认投入不高。你如果没有明确要求注释、模块说明、边界清单,GPT-5.3 Codex 可能直接交付一套跑得动但阅读门槛高的代码。

下面这个片段是典型风格示意,GPT-5.3 Codex 会优先交付最短执行路径:

# generated by gpt-5.3 codex style

async def sync_user(uid, db, cache):

u = await db.fetch(uid)

if not u:

return None

p = normalize(u)

await cache.set(uid, p, ttl=900)

return p

如果你把这个风格放在资深团队,问题不大;放在新人比例高、交接频繁的团队,后续维护压力会明显上升。因为模型省掉的解释,会转化为人工沟通成本。

对照看 Opus 4.6 风格,解释会更完整:

# generated by opus style

async def sync_user(uid, db, cache):

"""同步用户数据到缓存。

设计意图:

1) 数据不存在时立即返回,避免无效写缓存。

2) 统一通过 normalize 保证字段格式一致。

3) 设置短 TTL,降低脏数据停留时间。

"""

user_record = await db.fetch(uid)

if not user_record:

return None

normalized_payload = normalize(user_record)

await cache.set(uid, normalized_payload, ttl=900)

return normalized_payload

这也解释了为何 GPT-5.3 Codex 和 Opus 4.6 不该做“谁替代谁”的比较。两者本来就更适合分工,而不是单选。

四、把国产模型一起拉进来:你会看到更实用的梯队结构

很多团队现在不是只用两个海外模型,而是四层组合:GPT-5.3 Codex 做高压执行,Opus 4.6 做长上下文审校,国产模型做日常批量任务,人工做关键决策。这个组合的价值是预算弹性和故障韧性。

在日常脚本、模板化改写、批量格式整理这类任务里,国产模型完全可以承担主力,GPT-5.3 Codex 留给高复杂度编码。你把高价模型留在刀刃位置,整体 ROI 会更高。

如果你需要准备团队培训文档,建议把这五个入口词做成可点击卡片,统一放在内部 wiki:

- chatgpt镜像站

- chatgpt官网

- chatgpt中文版

- gpt镜像

- chatgpt国内使用

五、团队落地策略:把 GPT-5.3 Codex 放在正确工位

很多团队失败不是因为模型不够强,而是调度方式错了。GPT-5.3 Codex 推荐放在以下三个工位:

- 事故修复工位:快速补丁、快速回滚、快速验证。

- 原型冲刺工位:先拿可运行版本,尽早给产品验收。

- 重构突破工位:拆解旧模块时优先跑通主链路。

而审计、文档化、合规说明这些工位,交给更偏解释型模型更稳。你可以把流程设计成“GPT-5.3 Codex 先执行 -> 审校模型复核 -> 人工签收”,在保证效率的同时避免知识断层。

六、可直接复用的提示词流程(生产环境版)

为了让 GPT-5.3 Codex 既快又不失控,你可以采用下面这套流程提示词:

你是资深后端工程师。任务目标:在不破坏现有 API 的前提下完成模块重构。

请按以下顺序输出:

1) 先列出你识别到的硬约束(接口、事务、兼容性)

2) 给出最小改动方案(按文件清单)

3) 生成可运行代码

4) 输出回归测试清单

5) 标注本次改动的风险点与回滚方案

如果你发现 5.3 Codex 输出过于简洁,可以叠加一条“可维护约束”:

额外要求:每个关键函数必须附 2-4 行注释,说明设计意图与边界条件。

输出后追加“给接手同事的维护提示”,不超过 120 字。

这两段提示词的组合能明显改善 GPT-5.3 Codex 在团队协作中的可读性问题,也能减少评审阶段的反复追问。

七、30 天迁移实操:把模型比较变成可复用流程

很多团队看完对比后,第一反应是“全部切换到更快的模型”。这个动作风险很高。真正可靠的方式是做分阶段迁移,把 GPT-5.3 Codex 放进既有流程而不是替换流程。建议把迁移拆成四周:第 1 周只做基线采样,第 2 周引入执行层模型,第 3 周加入审校层,第 4 周再看成本和缺陷回流。这样你拿到的是可以复盘的数据,而不是一时的主观感受。

在基线采样阶段,任务不要贪多,选两类就够:一类是高压编码任务,一类是多人协作文档任务。高压任务看速度与回滚,协作任务看可读性与交接时长。用同一批输入材料分别跑旧流程与新流程,再统计“完成时长、返工轮次、测试通过率、评审耗时”。当这四项指标连续两周稳定改善,迁移才有扩大价值。

你还需要一个很关键的制度动作:建立失败样本库。每次失败都记录触发提示词、输入边界、错误表现、修复路径。只要这个库持续更新,团队对 GPT-5.3 Codex 的掌控会明显增强,因为大家不再重复踩相同坑位。模型能力在迭代,人类流程也要跟着迭代,二者同步时效率才会稳定提升。

迁移到第 4 周时,不要只看 token 费用。把成本拆成三层:模型调用成本、人工等待成本、返工补救成本。很多团队最终会得到一个反直觉结论:在高价值任务里,GPT-5.3 Codex 即使单次更贵,综合成本反而更低,因为它减少了上线窗口内的反复沟通与多轮改写。这类结论必须依靠日志和任务账本,而不是依靠印象。

为了让这套迁移机制长期有效,建议同步维护一个最小指标看板,字段不要太多,但每周必须更新。实践里可用的字段包括:任务类型、输入规模、是否跨文件、调用轮次、首次可运行时间、最终交付时间、返工次数、上线后缺陷数。这个看板最有价值的不是“看漂亮趋势图”,而是帮你在争议时用事实做决策。比如同一类任务到底要不要优先路由到 GPT-5.3 Codex,是否要加审校步骤,是否要切换提示词模板,都可以直接依据近四周数据决定。团队只要养成数据复盘习惯,模型能力差异就能稳定转化为交付优势,而不是停留在口头感受层面。

八、FAQ:你在选 GPT-5.3 Codex 时会问到的核心问题

Q1:GPT-5.3 Codex 和 Opus 4.6 应该二选一吗?

不建议。真实工程里更优解是组合。5.3 Codex 负责冲刺交付,Opus 4.6 负责审校与知识沉淀。这样可以把“交付速度”和“知识可维护性”同时保住,避免模型切换时出现文档断层。

Q2:GPT-5.3 Codex 适合新手吗?

可以用,但要配模板。若无明确约束,GPT-5.3 Codex 产物会偏“高手写给高手看”,新人学习门槛较高。给定固定输出框架后,新人也能稳定复现高质量结果,关键是模板和评审标准要成套提供。

Q3:怎么判断 GPT-5.3 Codex 输出可不可以直接上线?

看三项:自动化测试通过率、接口兼容清单、回滚预案完整性。只看“能跑起来”风险很高。建议把这三项写进 PR 模板,任何一项缺失都不允许进主分支。

Q4:国内团队如何稳定体验 GPT-5.3 Codex?

可以把 AIMirror GPT 中文站 作为主入口,外加备用入口和任务日志归档,避免单链路故障导致停工。入口稳定后,再通过任务分级把高价值请求优先路由到 GPT-5.3 Codex。

九、结语:关注结果,也要关注可维护性

GPT-5.3 Codex 的价值已经非常清晰:它在高压任务里的交付效率处于第一梯队。你如果要抢时间、救线上、冲里程碑,GPT-5.3 Codex 基本是优先项。但团队系统不是只看今天的速度,还要看三个月后的维护成本。把 GPT-5.3 Codex 放在执行层,把解释和审校层补齐,才是这轮模型升级里最务实的用法。

把模型能力变成稳定产出,关键仍是流程纪律。只要你的评审标准固定、日志记录完整、故障可回放,模型版本迭代就会变成正向资产,而不是频繁重学的负担。这一点在多团队并行协作场景尤其重要。